Lo que la IA exhibe no es la trampa, sino la obsolescencia

Los exámenes de ingreso a la UNAM y el IPN fueron vigilados con IA... pero quienes sean aceptados la seguirán usando para burlar el sistema.

👋 Hola,

Bienvenido a Sintetika, nuestro newsletter sobre futuro, innovación, tecnología y la construcción de la sociedad del mañana.

🧐 En esta edición encontrarás:

IA para vigilar los exámenes de ingreso a nivel superior… y para preservar un modelo caduco.

Los chatbots comienzan a desplazar a los medios como fuente de noticias.

El primer programa de TV hecho con IA ya llegó.

OpenIA quiere desligarse de su mecenas, Microsoft.

La cifra absurda que recibirá Alexandr Wang por convertirse en empleado de Meta.

“Debemos dejar de actuar como carceleros y, en su lugar, procurar preparar un entorno en el que hagamos lo menos posible para agotar al niño con nuestra vigilancia e instrucción.”

(Maria Montessori)

IA para vigilar los exámenes de ingreso a nivel superior… y para preservar un modelo caduco

Durante la aplicación del examen de ingreso al bachillerato (ECOEMS) en 2025, la UNAM y el IPN recurrieron a sistemas de inteligencia artificial para vigilar en tiempo real a los aspirantes: cámaras que detectan gestos inusuales, micrófonos que registran sonidos sospechosos, navegadores que bloquean pestañas externas, validación de IP y seguimiento ocular.

La imagen es clara: vigilancia total. Una suerte de Big Brother preuniversitario.

Aun así, algunos aspirantes encontraron grietas. Usaron celulares y presumieron vulnerabilidades en sus redes. Algunas decenas de pruebas fueron anuladas. No hubo filtraciones masivas, pero sí un síntoma: parece que el sistema ya no controla los bordes de su propio marco.

No es un caso aislado. The Guardian reveló que las universidades en el Reino Unido detectaron un aumento exponencial en el uso de inteligencia artificial para hacer trampa en trabajos escolares.

La reacción ha sido previsible: reforzar los sistemas de detección, endurecer las normas, perfeccionar el castigo.

Lo que no se ha discutido lo suficiente es lo obvio: la trampa es sólo un fragmento del problema; el tipo de saber y la forma en la que lo evaluamos es un fragmento mucho más grande.

La pedagogía moderna fue diseñada para el siglo XX: clases estandarizadas, exámenes de opción múltiple, originalidad entendida como ausencia de copia, conocimiento como acumulación de datos.

El modelo premia la obediencia del protocolo, no la creatividad. Valora la memoria, no la construcción de sentido.

Los estudiantes de hoy no viven ahí. La cultura digital les enseñó otra cosa: la información no es un fin, sino un insumo.

Se corta, se remezcla, se adapta, se transforma… y se hace meme. La autoría, en ese entorno, no siempre es individual ni lineal. Se parece más a una red que a una firma.

Para Audrey Watters, “la historia de la tecnología educativa es más una historia de control que de liberación.”

La defensa fundamentalista del conocimiento como propiedad puede terminar por inhibir la creatividad que se suponía debía fomentar.

El caso ECOEMS revela una paradoja: mientras los sistemas de vigilancia se vuelven más sofisticados, el modelo que intentan proteger es cada vez más obsoleto.

Porque la IA no es una amenaza externa: es el espejo de una transformación que buena parte del sistema educativo se resiste a asumir como herramienta.

El hecho: la evaluación tradicional —basada en la repetición de información— ha dejado de ser confiable como prueba de aprendizaje.

El hecho: el problema no es que los estudiantes usen IA, sino que el examen de dos instituciones clave en México no sabe cómo lidiar con algo que la IA puede resolver.

Y entonces recurren a la IA para levantar un muro. No para construir un puente.

La respuesta institucional ha sido doble: punitiva en el presente, nostálgica en el fondo.

Se castiga al estudiante que no respeta reglas de otro tiempo, mientras se idealiza una era en que el aula era un recinto cerrado y el profesor la fuente de la verdad.

Bienvenidos a las aulas y a las reglas de la Universidad (así, con mayúscula). Bienvenidos al siglo XX…

Pero ni los recintos ni las verdades se sostienen así hoy. Y varios alumnos seguirán buscando cómo simplificar su vida evadiendo esas reglas.

Susan D. Blum en My Word!: Plagiarism and College Culture, dice que muchos estudiantes no plagian con intención maliciosa, sino porque las reglas de autoría académica les resultan ajenas a su experiencia cultural.

Lo que la universidad llama "originalidad" muchas veces significa, en la práctica, reorganizar ideas ajenas sin nombrarlas. Es decir, hacer lo que siempre han hecho los universitarios: navegar entre textos y seguir la ruta que extraen de ellos.

La intertextualidad, como la conocíamos, murió… hace poco tiempo.

En este contexto, el verdadero problema no es que los estudiantes hagan trampa, sino que el sistema siga simulando que esa trampa puede evitarse sin revisar también el modelo.

El modelo que sostiene que aprender es repetir.

Que redactar es ensamblar fórmulas.

Que pensar es obedecer…

¿Qué alternativa hay?

La primera, admitir que la IA seguirá mejorando y demanda replanteamientos urgentes.

Y entonces: reformular la enseñanza como construcción, no como memorización.

Evaluar procesos, no resultados aislados.

Fomentar proyectos abiertos, desafíos reales, colaboración guiada.

Y sí, permitir el uso de IA, no como trampa, sino como herramienta de pensamiento.

Porque si el conocimiento está al alcance de todos, lo que importa ya no es repetirlo.

Es preguntarse qué se puede hacer con él.

Y, sobre todo, qué puedo hacer yo que la máquina no pueda hacer con un prompt.

Esa es, quizá, la nueva frontera de la educación: no sólo enseñar lo que ya está disponible, sino formar la capacidad de generar lo que todavía no existe.

Y en ese horizonte, los estudiantes que sólo saben reciclar conocimiento, pero no crearlo, serán los primeros desplazados, como vimos en una entrega anterior.

La vigilancia no salvará el modelo.

Sólo lo hará una pedagogía que renuncie a controlar... para volver a enseñar.

‘Soy un adolescente, y estoy ansioso por volver a casa para mi momento favorito del día: hacer la tarea…’, dijo nadie, nunca.

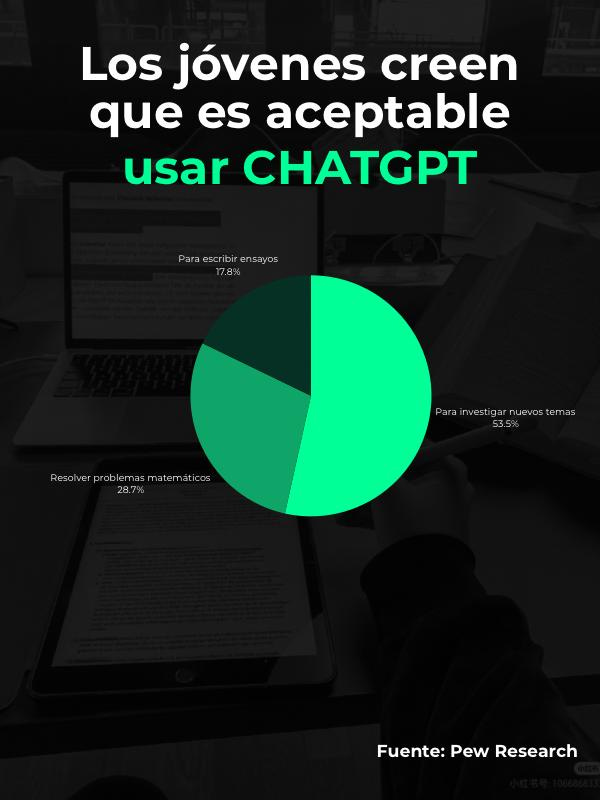

Pew Research encuestó durante dos años consecutivos a jóvenes de entre 13 y 17 años para saber si usaban ChatGPT en sus tareas escolares. La tendencia es reveladora:

También indagó cuáles son los temas donde se dan licencia para el uso de la IA y cuáles tienen un grado de condena:

La bola de nieve sigue rodando cuesta abajo.

🤖 Noticias desde el presente que construyen el futuro

Los chatbots son la nueva gran fuente de información: Digital News Report 2025

Es una realidad. Los chatbots se han convertido en una fuente de información recurrente para los usuarios. Con un 7% entre quienes formaron parte de la nueva entrega del Digital News Report del Reuters Institute, la inteligencia artificial empieza a protagonizar el consumo de noticias, conocimiento e información.

Ese 7% eligió la inteligencia artificial como su principal fuente de información. Destaca, además, que la adopción de los chatbots encuentra en el grupo de 18 a 24 y de 25 a 34 a quienes más lo utilizan en comparación con usuarios de mayor edad.

Entre las aplicaciones más utilizadas para dichos fines, ChatGPT aventaja por dos puntos porcentuales a Gemini, mientras que Perplexity y Claude registran sólo el 1% entre los entrevistados por el Digital News Report.

En el reporte, se revelaron los países que más cómodos se sienten y los que menos frente a contenido generado mayoritariamente por inteligencia artificial con mínima supervisión humana.

Crean el primer programa de televisión generado con inteligencia artificial

¿La televisión del futuro? Puede ser.

Un stunt que posiciona. Sin duda.

El consultor brasileño Vinicius Covas alcanzó notoriedad en redes al desarrollar el que presenta como “el primer programa de tv creado con inteligencia artificial”.

Se trata de pequeños segmentos que muestran el típico programa de revista presentado bajo el nombre de “Así de fácil con Memo Durán”.

Días más tarde, Vinicius replicó la fórmula creando “Los que nunca jugaron” bajo la misma fórmula.

ChatGPT quiere desligarse de Microsoft

Microsoft vio el potencial de Chat GPT prematuramente. No sólo le inyectó dinero, sino le cedió infraestructura.

Mil millones de dólares en 2019. A cambio, un acuerdo: una parte de lo tuyo me corresponde.

Microsoft quiere acceso a la propiedad intelectual de Windsurf, una startup adquirida por OpenAI.

Microsoft también quiere acceso a los productos de la inteligencia artificial general, si esta se logra.

OpenAI se resiste al control. Esta dispuesto a demandar a su mecenas por prácticas anticompetitivas.

En público aparentan cordialidad. En privado hay tensión.

No es un asunto menor. Son dos empresas que, cada cual a su manera, pueden moldear muchos aspectos del futuro de la humanidad.

Esto le van a pagar a Alexandr Wang por ser empleado de Meta

Meta quiere desarrollar una superinteligencia, para no quedarse atrás en la industria, como lo consignamos en la entrega anterior.

Zuckerberg sacó la cartera y compró Scale AI, para lograr su objetivo. Y la compró con el paquete completo, que incluye los servicios del fundador de la startup, Alexandr Wang.

La duda emergió pronto. Considerando que Meta es célebre por su ambiente tóxico, el mismo que hizo que los ingenieros que desarrollaron LLaMA se fueran, ¿cuánto le van a pagar a Wang para quedarse y cumplir el sueño de Zuckerberg?

Axios y Entrepreneur compartieron una cifra que obtuvieron de insiders: alrededor de 100 millones de dólares.

Un buen incentivo para tolerar a un jefe caprichoso. Aunque, si no funciona y eventualmente renuncia, Wang estará ocupado pensando qué hacer con el dinero que le quedó por la venta de Scale AI.

Hasta aquí la cuarta edición de Sintetika, el newsletter de Grupo Imagen que te explica el complejo futuro en sencillas palabras.

Suscríbete para recibirlo cada martes en tu bandeja de correo.