Código bélico: el activismo de los empleados de empresas tecnológicas

Mientras se oponen al uso de la tecnología con fines bélicos en nombre de la ética, los regímenes autoritarios sonríen silenciosamente.

👋 Hola,

Bienvenido a Sintetika, nuestro newsletter sobre futuro, innovación, tecnología y la construcción de la sociedad del mañana.

🧐 En esta edición encontrarás:

La rebelión de los programadores: cuando la ética frena (peligrosamente) al poder.

El gasto militar y su tendencia, que dice mucho.

Un microdron con el tamaño de un mosquito.

WhatsApp fue prohibido en oficinas gubernamentales de EU y Rusia siguió esos pasos.

Los robotaxis ya ruedan y todos esperamos ver algo.

No, el logo de Apple no es un homenaje a Turing.

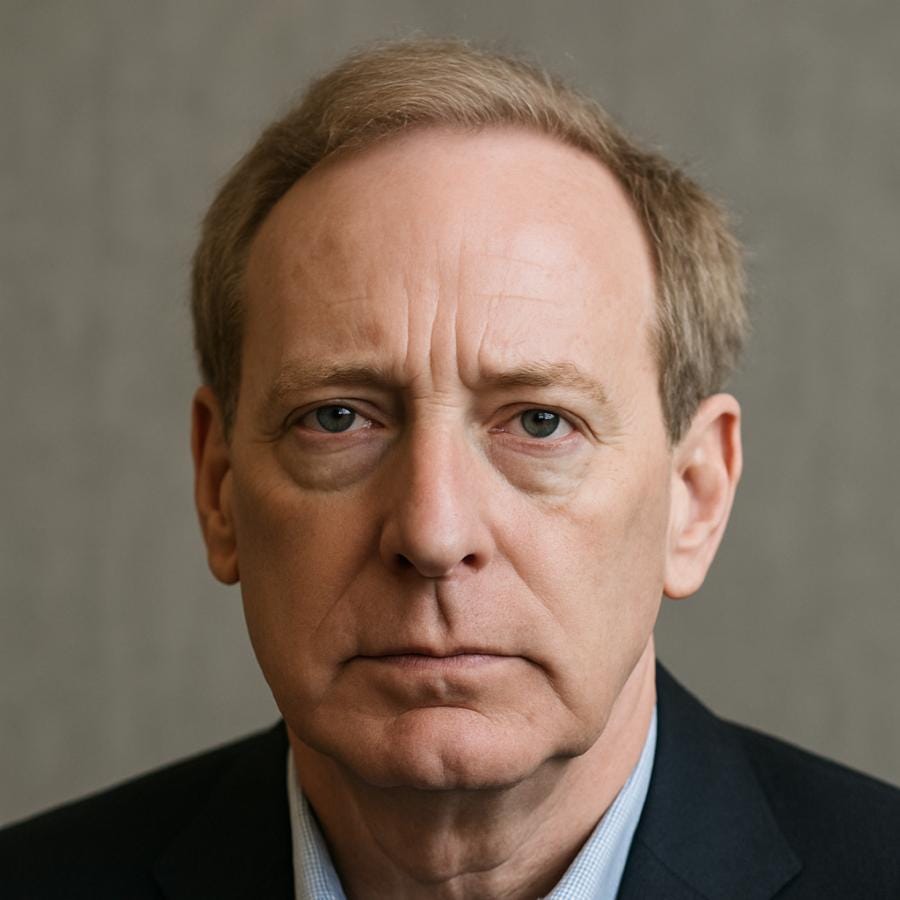

“Cuando las tecnologías que creas son usadas para atacar a otros civiles, estás en el lado equivocado de la historia”

(Brad Smith, presidente de Microsoft)

En mayo de 2025, un ingeniero interrumpió el escenario más brillante de Microsoft: la conferencia Build.

No llevaba pancartas. No pidió permiso. No suplicó.

—“Satya, ¿cómo muestras que Microsoft mata palestinos?”, gritó.

Fue escoltado hacia la salida. Silenciado. Despedido posteriormente. Su nombre: Joe Lopez.

La frase no desapareció.

Siguió resonando en las paredes de una industria que alguna vez se estereotipó como apolítica.

No protestó un activista. Protestó un programador.

Alguien que sabe que escribir código es tener la capacidad de incidir en la historia.

Pero ¿y si este acto ‘heroico’ de rebeldía representa al mismo tiempo una obstaculización contra los ideales de la democracia?

¿Y si los regímenes autoritarios ven el gesto con una sonrisa complaciente?

El siglo XXI no trajo la paz que prometieron los manuales.

Trajo guerra algorítmica. Invisible.

Trajo IA que clasifica, que predice, que sugiere blancos ideales para ser atacados. Que detecta personas dispuestas a creer en narrativas.

Azure, la plataforma en la nube de Microsoft, no dispara. Pero sostiene la infraestructura para que otros lo hagan con precisión quirúrgica.

OpenAI no construye armas. Pero sus modelos se han integrado, dice un reportaje publicado por AP, en sistemas que seleccionan objetivos en Gaza y Líbano.

Google entrenó algoritmos para el Project Maven, que analizaba imágenes de drones militares para detectar amenazas.

Amazon firmó el Project Nimbus, un contrato para proveer servicios al ejército israelí.

Cada empresa lo matiza.

Pero cada herramienta, cada línea de código, tiene huellas.

Y los ingenieros lo saben.

La ficción liberal sobre la tecnología se derrumba.

Esa que decía que los avances son neutros, que los desarrolladores actúan como técnicos, no como ciudadanos.

Que el código es ciencia pura, sin ideología.

La evidencia dice otra cosa.

Lo sabía Arendt cuando describió al burócrata nazi Adolf Eichmann, organizador de la logística del Holocausto, quien se defendió diciendo que él no mataba, solo “seguía órdenes”.

La obediencia también puede ser cómplice.

Las máquinas, los servidores, las redes, no son pasivas.

Son actores en una red de decisiones.

Y cuando uno de sus nodos —el humano— se rebela, la red cruje y revela partes incómodas de la realidad.

Ese quiebre ético es nuevo y llegó con los avances tecnológicos.

Hasta hace poco, los trabajadores callaban.

Hoy, escriben cartas, interrumpen eventos, se niegan a participar. Es un activismo nuevo.

En 2018, Google abandonó el Project Maven tras una carta firmada por más de 3,000 empleados.

En Amazon, cientos de trabajadores denunciaron contratos con ICE, agencia de migración de Estados Unidos, diciendo que actúa inhumanamente.

Y en Microsoft, nació el colectivo No Azure for Apartheid, formado por empleados que se niegan a “escribir código que mate”.

Este activismo no es marginal.

Es una conciencia incómoda en el centro del poder digital.

Pero esta conciencia tiene un costo. No cabe dentro de un esquema maniqueista.

Porque la guerra no espera.

Hay lugares donde nadie protesta.

En China, por ejemplo, el desarrollo tecnológico no se negocia.

La estrategia de fusión civil-militar obliga a cada empresa —privada en apariencia— a colaborar con el Estado.

Huawei, SenseTime, Baidu, iFlytek: todas participan en sistemas de vigilancia, control poblacional, defensa automatizada.

No hay ingenieros disidentes.

No hay cartas abiertas.

No hay huelgas de código.

Simplemente no puede haber.

Y eso crea una asimetría estructural en el poder global.

Mientras en Occidente los empleados de las tecnológicas levantaron el debate entre ética y estrategia, en los regímenes autoritarios no hay dilema: el avance es ley.

Allá el algoritmo no cuestiona. Que ni lo intente.

Entonces aparece la pregunta: ¿la ética debilita?

Porque mientras en Estados Unidos se frena el uso militar de la tecnología hecha en empresas, en China no hay obstáculos. Ni en Irán. Ni en Rusia.

Habría que aceptarlo: la tecnología no redime. No salva. No iguala.

También puede ser herramienta de dominación, de desigualdad, de vigilancia.

Puede ser un arma invisible, pero igualmente letal.

¿Es preferible un sistema ético que pierde a un sistema impune que gane?

Kate Crawford ofrece una respuesta dura, quizá que no genera consenso, pero sí es reveladora, en Atlas of AI: Power, Politics, and the Planetary Costs of Artificial Intelligence.

La inteligencia artificial, y por añadidura la tecnología actual, no es limpia.

Es tierra extraída, trabajadores explotados, datos arrancados de personas.

Es vigilancia, orden, control.

Fue diseñada para reforzar el statu quo, no para cambiar su cauce.

Por eso, dice, su uso militar no es un despropósito… Es parte normal de su lógica.

El poder y el dominio son inherentes al humano.

La IA no necesita disparar. Solo necesita identificar. Priorizar. Sugerir.

Los humanos hacen lo demás.

El ingeniero que protesta no se ve como soldado. Pero entiende que su línea de código puede matar. Y decide no escribirla.

Esa voz disloca la cadena de mando, pero sólo lo hace de un lado.

Las democracias permiten esa grieta. Y por eso son vulnerables.

En una guerra fría que ya no se libra entre ideologías, sino entre arquitecturas digitales, la lentitud, resultado del análisis de conciencia, podría representar una debilidad.

El disenso se convierte en amenaza interna.

¿O es al revés?

Quizá esa capacidad de decir no sea lo único que distingue una sociedad libre

de una máquina hecha para matar.

Hoy el campo de batalla no está solo en Gaza, Teherán o Kiev.

Está también en los servidores.

En los modelos de lenguaje.

En las tecnológicas que venden “servicios gubernamentales”.

¿Puede una concepción de la sociedad sobrevivir si permite el disenso mientras sus adversarios ni siquiera lo contemplan?

No lo sabemos.

Pero si la sociedad renuncia al derecho a decir no, entonces ya perdió algo más que una guerra.

Perdió el alma de su tecnología. Y quizá también la de la propia sociedad.

Gasto militar y tecnología

Sobre el tema de la tecnología de las empresas y el uso bélico por parte de Gobiernos, es lógico preguntarse algo:

¿Los gobiernos, con sus millonarios presupuestos, necesitan la infraestructura de la iniciativa privada?

La respuesta corta es sí. Lo que necesitan es principalmente la inversión en investigación.

De hecho, hay empresas tecnológicas que invierten más en investigación y desarrollo (I+D) que Gobiernos enteros. Una gráfica que muestre los montos en miles de millones de dólares (billions, en inglés) lo ilustra perfectamente:

Estados Unidos está deliberadamente fuera de esta gráfica porque el monto es notablemente más alto: 806 mil millones de dólares.

Y eso nos lleva a otra pregunta: ¿la inversión en tecnología militar tiene una tendencia? Nuevamente, sí.

Para el 2030, Global X ETFs predice que la inversión en gastos militares crecerá alrededor del 40% en el mundo, en comparación con 2024. La cifra es escalofriante: 3.3 billones de dólares (trillions, en inglés).

Inversión para la paz, dirán algunos.

🤖 Noticias desde el presente que construyen el futuro

En China se presentó un microdron en forma de mosquito… para espionaje militar

No sólo tiene el tamaño de un mosquito, sino incluso sus alas translúcidas. Lo presentaron orgullosamente en un reportaje del canal militar CCTV 7.

El dispositivo fue desarrollado por estudiantes de la Universidad Nacional de Tecnología de la Defensa (NUDT).

Su obstáculo principal por ahora es la batería, pero fue diseñado con un objetivo: reconocimiento y misiones especiales en el campo de batalla.

Estados Unidos ya no confía en WhatsApp. Y ahí sí está de acuerdo Rusia

Primero fue la Cámara de Representantes de Estados Unidos: prohibido el uso de WhastApp en todos los dispositivos del organismo.

Pero, ¿no el mismo WhatsApp presume el cifrado de sus conversaciones que garantiza la privacidad? Sí. Lo que no garantiza es la invulnerabilidad de las copias de seguridad.

Esta debilidad fue el origen de la prohibición.

Rusia andaba en las mismas. En nombre de su soberanía digital, desea no depender ni de WhatsApp ni de Telegram. Es más, nada del exterior.

La solución fue dictada por Putin: Max, una “superapp” inspirada en WeChat. La app puede gestionar mensajería, pagos, integración con servicios públicos, firma electrónica… se puede controlar todo.

¿Hasta las mismas actividades de los ciudadanos?

Los robotaxis por fin comenzaron a rodar

La promesa de la conducción autónoma de Elon Musk dio un paso con el lanzamiento de sus robotaxis en Austin.

Tesla ya liberó una flotilla de sus vehículos autónomos en la capital de Texas. Pero no es la única opción.

¿No era Waymo, de hecho, la opción establecida y con más experiencia? Sí. Lo que no ha tenido es la audacia, y el eco mediático, de Elon Musk.

Waymo andaba en lo suyo. En nombre de la seguridad, avanzaba con un perfil más bajo y metódico. Es más, casi sin ruido.

Mientras tanto, Tesla intenta sacudirse la mala reputación de su creador en los últimos meses con un auto que te lleva, sin piloto, a donde pidas, en un rango limitado de Austin y por sólo $4.20 dólares el viaje.

No lo deseamos, pero seguro todos hemos pensado en el primer gran error de esta tecnología.

Que no, que el logo de Apple no es un homenaje a Alan Turing

Con cierta frecuencia suele resurgir en redes sociales la hipótesis de que el logo de Apple es un homenaje a uno de los genios que descifró la máquina Enigma, lo que a la postre fue determinante para detener la Segunda Guerra Mundial.

La historia para sustentarlo es bella, pero falsa. Turing murió por consumir cianuro y en su cama se encontró una manzana mordida, según la investigación.

Sin embargo, para desmentir esta historia hay que remitirse al primer logo de Apple: Isaac Newton debajo de un manzano.

Los demás es, literalmente, historia.

Hasta aquí Sintetika, el newsletter de Grupo Imagen que te explica el complejo futuro en sencillas palabras.

Suscríbete para recibirlo cada martes en tu bandeja de correo.